Mit dem Release von ChatGPT im November 2022 brach ein Hype um den Chatbot los, der sich mit einer Million Anmeldungen innerhalb von fünf Tagen nach Veröffentlichung schon ankündigte. Mit 100 Millionen Nutzern nach drei Monaten ist es die bis dato am schnellsten wachsende Verbraucher-Anwendung. Die Fähigkeiten des dialogischen Chatbots reichen von Fragenbeantwortung über Textzusammenfassungen und Gedichte schreiben bis hin zu Codegenerierung und -verbesserung.

Expert:innen gehen davon aus, dass es nicht dabei bleiben wird. Es wird erwartet, dass ChatGPT und Weiterentwicklungen bald live simultan übersetzen, Videos und Bildmaterial analysieren und erstellen können und noch in weitere Produkte (z.B. Word) integriert werden.

Ein Startschuss für Big Tech eine konkurrenzfähige Anwendung auf den Markt zu bringen

Mit dem Release von ChatGPT war gleichzeitig der Startschuss für alle großen Konkurrenzunternehmen gefallen, nachzuziehen und eine eigene Anwendung herauszubringen.

Dass in diesem Wettlauf der Großunternehmen Schnelligkeit den Vorrang vor Qualität hat, zeigt sich in frequenten neuen Meldungen über verwunderliche bis hin zu verstörenden Antworten vergleichbarer Chatbots wie BingAI oder Alpaca. Es entsteht der Eindruck, dass aufgrund des (selbstgemachten) Zeitdrucks unausgereifte Produkte auf den Markt kommen.

Das aktuellste Beispiel ist der kürzlich veröffentlichte Chatbot von Microsoft, BingAI. Er wurde nach nur einer Woche online wieder vom Netz genommen und stark überarbeitet, nachdem Kolumnist Kevin Roose der KI seltsame Antworten entlocken konnte. Hier kannst du den gesamten Chatverlauf lesen. Der BingAI zugute gehalten werden kann, dass der Journalist den Bot stark reizte und viele Antworten nur hypothetisch gemeint waren.

Doch abseits von Trick-Questions, die die Grenzen von Chatbots austesten sollen, interessieren wir uns mehr dafür, wie verlässlich die KIs hinsichtlich einfacher Aufgaben mit harten Fakten und Zahlen umgehen. Wie sehr können wir uns auf ihre Antworten, Informationsextraktionen und Zusammenfassungen verlassen? Die Frage ist hochrelevant, wurden die KIs schließlich zu einem großen Teil dazu entwickelt, uns zeitaufwändige, fehleranfällige Aufgaben abzunehmen und mit technischer Präzision auszuführen.

Ein unfertiges Produkt für kurzfristigen Hype

Der Kolumnist Dimitri Brereton behauptet in seinem Artikel, Microsoft habe wissentlich ein unfertiges Produkt released, um für einen kurzzeitigen Medienhype zu sorgen. Er testete die Demo und deckte sehr schnell gravierende Mängel von Microsofts Chatbot auf.

BingAI reagierte auf die Kritik an ChatGPTs fehlenden Quellenangaben und zeigt seitedem in der Vorschau der Anwendung die Quellen, aus denen die angezeigten Informationen stammen. So konnte Brereton einsehen, dass Produktbeschreibungen gar nicht mit dem aktuellen Modell, zu dem er suchte, zusammenpassten und stattdessen der Beschreibung des Vorläufermodells entnommen waren.

Auf die Anfrage nach Restaurantbewertungen zu einem populären Restaurant behauptete BingAI, dass es auf Google dazu keine Rezensionen gäbe, obwohl mehr als 500 davon zu finden waren.

Am überraschendsten war jedoch das Versagen bei der Auswertung von Zahlen in Bilanzen und Finanzberichten. Es wurden Zahlen angegeben, die nicht mal im Bericht standen, teils gab es Vertauschungen und falsche Berechnungen.

Verlässt man sich hier blind auf die Angaben der KI, kann das weitreichende negative Folgen haben, wie falsche Berechnungsgrundlagen für Folgeaufgaben.

Zusätzlich zu den aufgezeigten Mängeln gibt es technische Limitierungen, die die vermeintliche Allwissenheit der Chatbots erheblich beschränken. Das ist ein fehlender Internetzugang: ChatGPT kann nicht auf das Internet zugreifen wie ein Mensch eine Googleanfrage senden kann. Er weiß nicht, was gestern im britischen Parlament beschlossen wurde, wie die aktuellen Bilanzen der fünf größten Dax-Unternehmen ausfallen oder was im Moment in der Ukraine vor sich geht. Der Chatbot basiert ganz auf Trainingsdaten – die aktuellsten davon sind von September 2021. Alles, was seither passiert ist, ist der KI unbekannt.

Um sich über das aktuelle Zeitgeschehen zu informieren, ist ChatGPT also unbrauchbar. Die Angst, Google oder andere Suchmaschinen könnten dadurch ersetzt werden, scheint somit unbegründet.

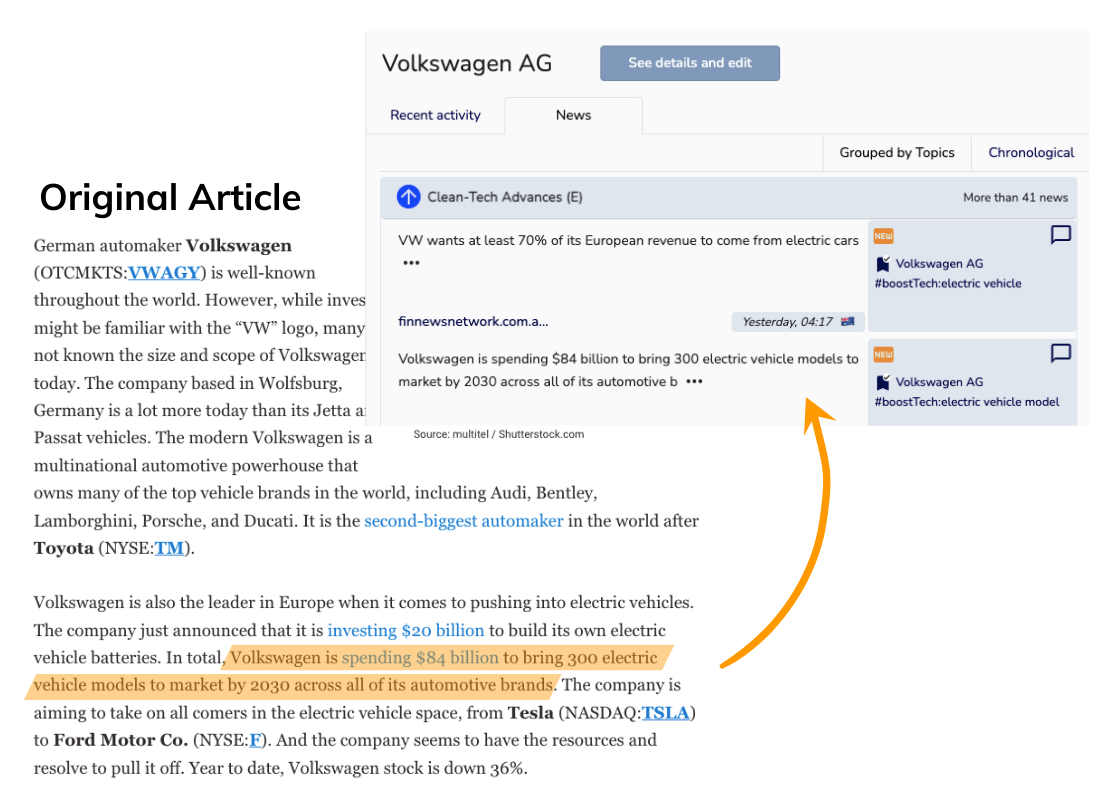

Verlässliche, aktuelle Nachrichten aus seriösen Quellen

Eine verlässliche Quelle für aktuelle Informationen hat Glanos mit seinem news-monitor.ai entwickelt. Hier werden ausschließlich seriöse Nachrichtenquellen herangezogen und von einer KI “gelesen” und sortiert.

Es werden alle Quellen angegeben. So ist für dich immer nachvollziehbar, woher eine Information stammt. Wir legen auch offen, nach welchen Regeln die KI Nachrichten als relevant extrahiert.

Im Dashboard kannst du dein personalisiertes Portfolio erstellen und nach einem individuellen Zeitintervall verlässlich und kontinuierlich über die Themen informiert werden, die für dich relevant sind.

Möchtest du zum Beispiel wissen, was dein größter Konkurrent im Bereich Blockchain so macht? Oder ob dein Zulieferer gerade mit Materialknappheit zu kämpfen hat und das deine eigene Produktionsketten gefährden könnte? All das kannst du in wenigen Minuten herausfinden und kontinuierlich auf dem Laufenden bleiben.

Die strukturierten Ergebnisse können gesammelt, exportiert und sogar mit deinen Kolleg:innen geteilt werden. So erhältst du gesicherte Informationen, die dir Chatbots aufgrund der fehlenden Herkunftsangaben nicht bieten können.

Probiere es einfach mal aus! Für Fragen zu Umwelt, Sozialem und Unternehmensführung haben wir extra die esg-monitor.ai entwickelt, die dich über ESG-Themen auf dem Laufenden hält.